AI助手聊天、问答、写代码早已不新鲜,但如果你对智能音箱说“给我唱首歌”,大多数AI助手依然只能回复一句“对不起,我没有这个功能”。让AI“开口唱歌”而非“开口说话” ,是当前人工智能领域最热门的前沿技术之一——歌唱语音合成(SVS, Singing Voice Synthesis) 。它究竟是技术难点,还是下一个千亿级应用爆发点?本文将从技术演进、核心原理到面试考点,带你一次读懂AI唱歌的全貌。

<h2>一、痛点切入:为什么我们需要AI唱歌?</h2>在传统方案中,想让AI生成歌声,开发者通常采用语音合成(TTS, Text-to-Speech)加音高偏移的方式——也就是让AI像正常人一样说话,再把语调整体“拉高”。但这种方式的代码实现思路大致如下:

传统方案伪代码:TTS + 音高偏移 = “假唱歌” def traditional_sing(lyrics, melody):第一步:用TTS合成正常语音 speech = tts_model.synthesize(lyrics) 输出:正常说话 第二步:统一拉高基频(简单粗暴) pitched = pitch_shift(speech, semitones=5) 整体升高5个半音 第三步:叠加节奏信息 sung = apply_rhythm(pitched, melody.tempo) return sung 结果:像机器人“念歌”

这种方案的缺点非常明显:

音质失真严重:说话时的发音方式和唱歌完全不同(气息、颤音、咬字力度等),强行拉高音高后声音会变得像“电子鹦鹉”,机械感极强

情感表达为零:唱歌需要强弱对比、情感递进,而传统TTS无法输出带有“情感张力”的声线

控制粒度粗糙:无法精细控制每个音符的时长、音高曲线,更无法实现转音、滑音等演唱技巧

无法适配新歌手:换一个歌手音色需要重新训练模型,开发成本极高

正是这些痛点,推动研究者从根本上重新思考AI歌声合成的技术路径。解决思路的核心是:不再把唱歌当作“说话的变种”,而是将其作为一个独立的生成任务来建模。

<h2>二、核心概念讲解:SVS</h2>定义:SVS(Singing Voice Synthesis,歌唱语音合成) 是一种根据歌词和乐谱生成自然人声演唱的技术-1。与传统TTS不同,SVS需要对音高、音律以及演唱风格进行精细控制,以实现自然且富有表现力的歌声输出。

一句话理解:TTS是让AI“念稿子”,SVS是让AI“唱歌”。

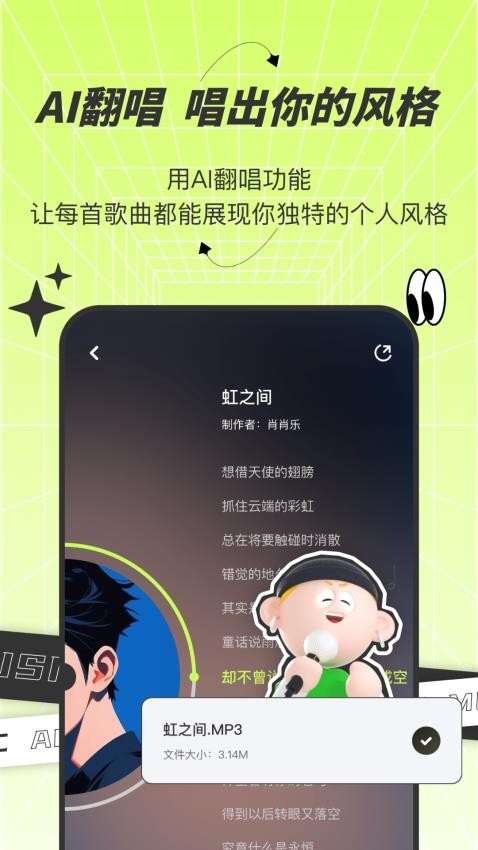

为什么需要SVS?它可以应用于虚拟歌手(如AI偶像、数字人演唱会)、音乐创作辅助(快速生成Demo)、歌词演绎验证、多语言歌曲生成等场景,大幅降低音乐创作的门槛与成本-1。

与技术浪潮的对比:与近期热门的Music Generation(自动生成整段音乐或伴奏) 不同,SVS专注于可由MIDI乐谱控制的人声生成,更贴近“歌手”这个角色的专业化需求-2。

<h2>三、关联概念讲解:SVC</h2>定义:SVC(Singing Voice Conversion,歌声转换) 是一种将源演唱者的歌声转换为目标音色的技术,保留原有的歌词与旋律,仅替换音色-33。

它与SVS的关系:

| SVS(歌唱语音合成) | SVC(歌声转换) | |

|---|---|---|

| 输入 | 歌词 + 乐谱(MIDI) | 已有歌声(源歌手) |

| 输出 | 从零生成完整歌声 | 保留旋律、替换音色 |

| 典型应用 | AI歌手从零创作 | 翻唱、“AI孙燕姿” |

| 技术难度 | 更高(需建模音高、时长) | 相对较低(音色迁移) |

一句话区分:SVS是“创作”,SVC是“换声”。近年来大火的话题“AI孙燕姿”,其底层技术正是SVC,通过克隆真实歌手音色快速生成翻唱效果-30。

<h2>四、概念关系与总结</h2>两者共同构成了AI歌声技术栈的“两大支柱”:

SVS = 设计 → 落地:从歌词和乐谱出发,构建一个完整的“数字歌手”

SVC = 迁移 → 复用:将已有歌声中的音色替换为目标音色

一句话记忆:SVS负责“从无到有地创作歌声”,SVC负责“用别人的嗓子唱你的歌”。

<h2>五、代码示例:零样本歌声合成实战(基于SoulX-Singer)</h2>以2026年2月开源的工业级SVS模型SoulX-Singer为例,展示零样本歌声合成的简洁实现。该模型基于超过42000小时训练数据,支持普通话、英语、粤语三种语言的零样本歌声生成-1-9。

基于 SoulX-Singer 的零样本歌声合成示例 项目地址:https://github.com/Soul-AILab/SoulX-Singer from soulx_singer import SVSModel 1. 加载预训练模型(无需额外训练) model = SVSModel.from_pretrained("Soul-AILab/SoulX-Singer") 2. 准备输入:歌词 + MIDI乐谱 lyrics = "小燕子,穿花衣,年年春天来这里" midi_score = "twinkle.mid" MIDI乐谱文件 3. 配置目标音色(零样本!不需要训练) target_timbre = "reference_singer.wav" 仅需5秒参考音频即可 4. 生成歌声(仅需一行核心代码) sung_audio = model.synthesize( lyrics=lyrics, music_score=midi_score, 乐谱控制方式 timbre_ref=target_timbre, 零样本克隆目标音色 control_mode="midi", Music Score模式,支持音符级控制 ) 5. 输出音频文件 save_audio(sung_audio, "output_singing.wav")

执行流程解析:

模型读取歌词文本和MIDI乐谱,建立歌词与音符的精细对齐关系

从参考音频中提取目标音色的声学特征(零样本,无需训练)

采用Flow Matching建模范式将歌声生成建模为音频补全任务-1

通过音符级对齐机制精确控制每个音符的起止时间、音高和持续时长-1

声码器将声学特征转换为最终波形

关键注解说明:

control_mode="midi":基于MIDI乐谱生成,支持音符级时长与节奏控制,适用于专业音乐创作另可切换为

control_mode="melody":基于参考旋律生成,适用于翻唱与风格迁移-1零样本指无需针对目标歌手做任何微调训练,仅靠参考音频即可完成音色克隆-1

SVS的核心技术依赖于以下几个底层支撑:

① Flow Matching(流匹配)生成范式

以SoulX-Singer为代表的主流模型,采用Flow Matching替代传统的扩散模型,将歌声合成问题建模为音频补全(Audio Infilling)任务。Flow Matching的优势在于训练稳定性更高、生成质量更好,且推理速度显著提升-1-3。

② 音符级对齐机制(Note-Level Alignment)

歌声合成中最大的难点是“歌词—旋律—发声”三者的强耦合。音符级对齐机制通过构建文本、MIDI音符与声学特征之间的精细映射,使得每个音符的起止时间、音高、持续时长都能被独立建模和控制,这是SVS区别于TTS的核心技术突破-1。

③ 大规模数据支撑

零样本泛化能力依赖海量高质量训练数据。SoulX-Singer依托超过42000小时的歌声数据训练,覆盖多语言、多音色及多种演唱风格,才得以实现“未见过的歌手也能唱得好”的能力-1。

④ 底层依赖的AI基础技术

变分自编码器(VAE) :用于声学特征的压缩与重建

扩散/流匹配模型:从噪声逐步生成高质量音频

声码器(Vocoder) :将声学特征(如梅尔谱)转换为可播放的波形

文本编码器:将歌词转换为语义向量,通常基于BERT等预训练模型

1. 面试题:请简要说明SVS和TTS的核心区别。

参考答案:SVS(歌唱语音合成)和TTS(文本到语音合成)的核心区别在于控制维度和输出目标。TTS只需保证发音清晰、语调自然即可;而SVS需要额外精确控制音高(Pitch)、时长(Duration)和演唱风格(Style)。TTS的输出是“说话声”,SVS的输出是“歌声”,后者对音准、节奏、情感表现力的要求远高于前者-1。

踩分点:分别点出控制维度(音高/时长/风格)、输出形式(说话/唱歌)、技术难度差异,三层次递进。

2. 面试题:SVS中“零样本”(Zero-Shot)是什么意思?如何实现?

参考答案:零样本指模型在训练过程中未见过目标歌手的情况下,仅通过少量参考音频(如3-5秒)即可生成该歌手音色的歌声。其实现依赖两个关键:一是大规模、多样化的训练数据(如42000小时以上),使模型学到通用的声学表征;二是特征解耦技术,将“音色特征”与“内容特征”分离,实现音色的独立迁移-1-46。

踩分点:定义清晰(未见过的歌手+少量参考)、依赖条件(大规模数据+特征解耦)、举例说明。

3. 面试题:Flow Matching与Diffusion Model在歌声合成中有什么区别?

参考答案:两者都是生成式模型的核心技术。Diffusion Model通过逐步向数据添加噪声再逆向去噪来生成样本,训练稳定但推理较慢;Flow Matching通过学习从先验分布到数据分布的最优传输路径直接生成,推理速度更快,训练稳定性更高。在SVS领域,Flow Matching因更适合对音高、时长等精细条件的控制而逐渐成为主流范式-1。

踩分点:两种机制的核心差异(扩散 vs 流匹配)、SVS领域的选型理由(精细控制能力)、各有优劣。

4. 面试题:如何评估一个AI歌声合成模型的好坏?

参考答案:评估维度包括客观指标和主观评测。客观方面:音高准确率(F0)、发音清晰度(CER/WER)、音色相似度(SIM);主观方面:自然度MOS分(Mean Opinion Score)、情感表现力。在学术评测中,常使用GMO-SVS等标准化数据集和SoulX-Singer-Eval等零样本专用测试集-3。

踩分点:主客观两条线、具体指标名称、数据集示例。

<h2>八、结尾总结</h2>回顾全文,我们完成了以下知识链路:

| 环节 | 核心内容 |

|---|---|

| 痛点 | 传统TTS无法满足歌声合成的精细控制需求 |

| 概念A(SVS) | 根据歌词+乐谱生成歌声,核心是对音高/时长的精准建模 |

| 概念B(SVC) | 将源歌声转换为目标音色,“换声不换调” |

| 技术实现 | Flow Matching + 音符级对齐 + 大规模数据(42000h+) |

| 底层支撑 | VAE、扩散/流匹配、声码器、文本编码器 |

| 面试考点 | SVS vs TTS、零样本原理、Flow Matching、评估指标 |

重点与易错点提示:

❗ SVS与SVC不要混淆:SVS是从零合成,SVC是音色转换

❗ “零样本”≠“零数据训练”,指推理阶段无需针对目标歌手训练

❗ 音符级对齐是SVS区别于TTS的核心技术机制,面试时可重点展开

AI歌声合成技术正处于从“实验室玩具”走向“工业可用”的关键拐点。随着SoulX-Singer、VITA-Qinyu等高质量开源模型的密集发布,以及Flow Matching、DiT等先进架构的持续迭代,我们有理由相信:未来你的AI助手不仅能陪你聊天,还能即兴为你唱一首歌。

本文内容基于2026年2月至4月公开发表的技术论文与开源项目撰写,数据来源包括SoulX-Singer技术报告、ACE-Step 1.5论文、LongCat-AudioDiT论文等。