据Fortune Business Insights最新数据,2025年全球医疗保健AI市场规模达393.4亿美元,预计2026年将同比上涨42%至560.1亿美元,约合3869亿元人民币-6。在这个千亿级赛道中,AI问诊助手正从概念走向规模化落地——但将通用大模型转化为可商用、可控、可信的医疗问诊系统,远非套一层Prompt那么简单。本文将从架构设计到代码实现,完整拆解可商用AI问诊系统的技术全貌。

一、痛点切入:为什么通用大模型不能直接做问诊?

接入DeepSeek或ChatGPT的API、套一层“你是一名专业医生”的Prompt,最快几周就能上线一个医疗对话Demo。但踩坑几乎是必然的:

幻觉问题:大模型可能在“很流畅地胡说八道”,给出看似合理但实际错误的医疗建议

回答不可控:无法约束回答范围,更谈不上做智能分诊

无法结构化沉淀:对话内容无法自动转化为电子病历字段

数据合规风险:医疗数据的隐私保护要求极为严苛

所以,真正能上线商用的AI问诊系统,一定不是“纯对话机器人”,而是一个多层架构的组合方案。

二、核心概念:RAG(检索增强生成)

标准定义

RAG是Retrieval-Augmented Generation的缩写,中文意为“检索增强生成”。它是一种将外部知识检索与大语言模型生成相结合的技术范式。

为什么AI问诊必须做RAG?

医疗场景不能依赖大模型的“记忆”——模型训练数据可能过时、来源不明、不可追溯。RAG的核心价值在于:

可追溯:每个回答都能指向具体的医学资料来源

可更新:知识库独立于模型,更新即生效

可审核:检索内容可由医学专家审核

可控回答:生成被限定在检索到的医学资料范围内

代码示例:医疗知识向量库构建

from sentence_transformers import SentenceTransformer import faiss import numpy as np 1. 加载中文Embedding模型 model = SentenceTransformer("moka-ai/m3e-base") 2. 医学知识文档库(实际生产环境会从医学文献中抽取) docs = [ "发烧超过38.5度持续三天建议就医", "胸闷胸痛可能与心血管疾病有关,需排查冠心病", "儿童咳嗽超过一周需排查肺炎,建议就医", "空腹血糖≥7.0 mmol/L可诊断为糖尿病" ] 3. 向量化并构建FAISS索引 embeddings = model.encode(docs) index = faiss.IndexFlatL2(768) 768维向量 index.add(np.array(embeddings).astype("float32")) 4. 问题检索函数 def search_knowledge(query: str, top_k: int = 3): q_emb = model.encode([query]) D, I = index.search(np.array(q_emb).astype("float32"), top_k) return [docs[i] for i in I[0]] 5. 构建安全Prompt def build_safe_prompt(question: str, knowledge: list): context = "\n".join(knowledge) return f""" 你是一名专业医生助理,只能依据以下医学资料回答,禁止编造信息: 【资料】 {context} 【问题】 {question} 请给出安全、保守、医学合规的建议。 """

RAG流程可概括为:用户问题 → 向量检索 → 找到相关资料 → 拼接Prompt → 交给大模型生成,从而从根本上规避模型“自由发挥”的风险-11。

三、关联概念:医疗知识图谱

标准定义

知识图谱(Knowledge Graph)是一种结构化的语义网络,以“实体-关系-属性”的三元组形式存储领域知识。在医疗场景中,实体包括疾病、症状、药物、检查项目等,关系包括“A的症状是B”“A的治疗药物是C”等。

与RAG的关系:互为补充

| 维度 | RAG | 知识图谱 |

|---|---|---|

| 定位 | 检索非结构化文本 | 查询结构化关系 |

| 优势 | 理解自然语言、生成流畅回答 | 精确表达复杂关联、可推理 |

| 短板 | 无法表达多跳关系推理 | 缺少自然语言生成能力 |

一句话总结:RAG负责“找到相关材料”,知识图谱负责“理解复杂关系”,二者结合才是完整的医疗智能问答方案-12。

四、可商用AI问诊系统的完整架构

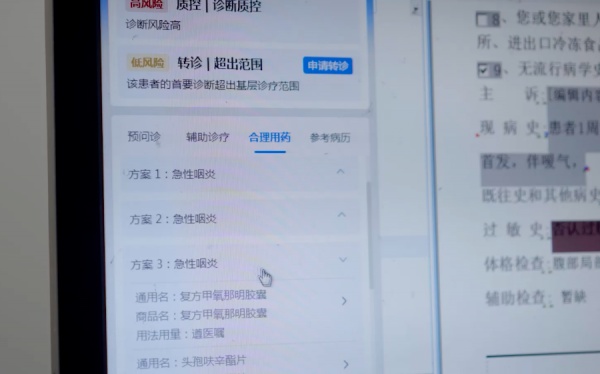

成熟的AI问诊系统采用“大模型 + 医疗知识库(RAG)+ 分诊规则引擎 + 业务系统”四层架构-11:

用户层(小程序/App/H5) ↓ 问诊对话服务(会话管理、上下文追踪) ↓ AI能力层 ├─ 大模型推理(LLM) ├─ 医疗知识库(RAG) ├─ 症状识别NLP └─ 分诊规则引擎 ↓ 业务系统层 ├─ 医生排班 │ 挂号系统 ├─ 电子病历 │ 处方系统 └─ 支付系统

会话管理代码示例(Redis)

import redis import json r = redis.Redis(host='localhost', port=6379, decode_responses=True) def save_session(uid: str, msg: dict): key = f"chat:{uid}" history = r.get(key) history = json.loads(history) if history else [] history.append(msg) r.set(key, json.dumps(history), ex=3600) 1小时过期 def get_session(uid: str): history = r.get(f"chat:{uid}") return json.loads(history) if history else []

症状结构化抽取(简单NLP)

import re SYMPTOM_RULES = { "发烧": r"发烧|高烧|发热|体温升高", "咳嗽": r"咳嗽|咳|干咳|咳痰", "胸痛": r"胸痛|胸闷|心口疼", "头痛": r"头痛|头疼|偏头痛" } def extract_symptoms(text: str): symptoms = [] for symptom, pattern in SYMPTOM_RULES.items(): if re.search(pattern, text): symptoms.append(symptom) return symptoms

分诊规则引擎示例

def triage_decision(symptoms: list): """根据症状决定分流方向""" urgent_symptoms = {"胸痛", "呼吸困难", "大出血", "意识不清"} moderate_symptoms = {"高烧", "剧烈头痛", "持续呕吐"} if any(s in urgent_symptoms for s in symptoms): return {"level": "紧急", "action": "立即转人工急诊"} elif any(s in moderate_symptoms for s in symptoms): return {"level": "中等", "action": "推荐专科问诊"} else: return {"level": "普通", "action": "AI自助问答"}

五、底层原理支撑

上述能力背后依赖以下核心技术栈:

| 技术 | 支撑作用 |

|---|---|

| Embedding模型(如BGE、M3E) | 将医学文本转化为语义向量,支撑RAG检索 |

| 向量数据库(如FAISS、Milvus) | 高效存储和检索百万级知识向量 |

| 命名实体识别(NER) | 从用户对话中识别“疾病名”“药物名”“症状”等医学实体 |

| 大语言模型(LLM) | 语义理解与自然生成,输出符合医学规范的建议 |

以NER为例,前沿方案采用Chinese-RoBERTa + BiGRU架构实现命名实体识别,F1分数可达97.55%-40。实际生产环境中,还会集成LangGraph实现复杂的多轮诊断工作流-33。

六、高频面试题与参考答案

面试题1:设计医疗问诊系统,如何平衡AI幻觉风险与效率?

参考答案(答题要点) :

医疗场景的核心原则是宁可漏诊也不能误诊,系统设计必须把“防幻觉”放在第一位,效率提升是在安全基础上的加分项-51。

四层防护体系:

RAG层:所有回答必须基于权威医学资料,大模型不允许凭空编造

边界控制层:通过Prompt工程限定AI只能做“信息整理”,禁止输出诊断结论和处方

风险分级层:根据症状严重程度自动分流,轻症走AI自动回复,高危直接转人工

人工兜底层:所有AI建议需经医生审核确认,或明确标注“AI生成,仅供参考”

面试题2:请简要说明RAG与模型微调的区别及各自适用场景

| RAG | 模型微调 | |

|---|---|---|

| 适用场景 | 知识频繁更新、需要来源追溯 | 固定格式任务、风格/逻辑调整 |

| 优点 | 实时更新、可追溯、成本低 | 效果好、推理快 |

| 缺点 | 检索质量依赖知识库构建 | 知识固化、更新需重新训练 |

| 医疗场景 | ✅ 医学知识问答 | ❌ 不建议(知识更新慢) |

面试题3:医疗问诊系统中的多轮对话如何管理状态?

核心技术手段:

使用LangGraph等框架构建状态图,维护完整的诊断过程状态(患者信息、症状列表、检查结果、初步诊断等)

通过Redis缓存对话历史,设置合理过期时间

实现上下文窗口管理,保留关键信息而非全量历史,在长尾会话中平衡效率与准确性

应用注意力机制(如Transformer的上下文编码)实现跨轮次信息整合

七、总结与展望

本文系统梳理了AI问诊助手从痛点分析 → RAG核心概念 → 知识图谱 → 四层架构 → 代码实现 → 面试要点的完整知识链路,核心要点可归纳为:

✅ 通用大模型不能直接用于医疗问诊,必须组合RAG + 规则引擎 + 业务系统

✅ RAG负责“找到资料”,知识图谱负责“理解关系”,LLM负责“自然生成”

✅ 安全第一:RAG检索 → 边界控制 → 风险分级 → 人工兜底,四层防幻觉

✅ 代码层面:Embedding向量化 + FAISS检索 + Redis会话管理,即可搭建最小可行系统

下一篇文章将深入探讨LangGraph在AI问诊中的工作流设计,包括状态管理、条件路由和医生审批节点的实现,敬请期待。