2026年4月10日,北京

手机屏幕AI助手正从传统语音问答向“能看会做”的智能体进化。在Gemma 4、Ferret-UI Lite等端侧大模型集中发布的背景下,理解手机端AI智能体的技术架构已成为开发者与面试者的必修课。本文从硬件芯片、轻量化模型、推理框架到端云协同,带你建立完整技术认知链路。

一、开篇引入:为什么手机屏幕AI助手值得你深入掌握?

手机屏幕AI助手是当前移动端AI领域最热门的技术方向之一。从最初只能完成“设闹钟、查天气”的基础语音助手,到如今能“看懂屏幕、自主操作”的智能体(Agent),这项技术正在深刻重塑人机交互方式。

很多学习者面临这样的困境:会用AI助手,但不懂背后的工作原理;听说过端侧大模型、NPU、Agent这些概念,却理不清它们之间的关系;面试时被问到“端侧AI如何部署”时,不知从何答起。

本文将从硬件芯片、轻量化模型、推理框架到端云协同,由浅入深地帮你建立完整的知识链路。读完本文,你不仅能理解手机屏幕AI助手的技术全貌,还能掌握核心代码示例和高频面试考点。

二、痛点切入:传统AI助手为什么不够“聪明”?

先来看一段传统AI助手的实现逻辑:

传统方案:纯云端调用 import requests def ai_assistant_query(user_input): 将用户语音/文字发送到云端 response = requests.post( "https://api.cloud-ai.com/v1/chat", headers={"Authorization": "Bearer YOUR_API_KEY"}, json={"prompt": user_input} ) return response.json()["answer"] 问题:无法操作手机、依赖网络、隐私风险

这种方案存在三大硬伤:

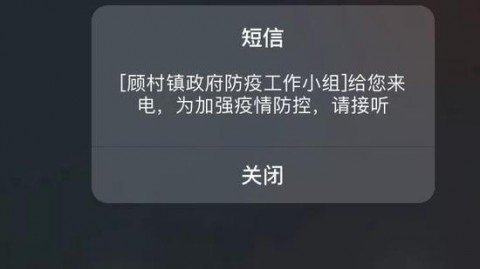

依赖网络:断网即“哑巴”,响应延迟不可控

无法操作手机:只能“说”,不能“做”,无法跨App完成任务

隐私风险:用户数据需上传云端,敏感信息存在泄露隐患

即便到了2024年,市面上超过九成的AI手机核心功能依然需要依赖云端服务器才能实现,一旦断网就成了摆设-4。

三、核心概念讲解:手机屏幕AI智能体(Agent)

3.1 标准定义

手机屏幕AI智能体(Mobile Screen AI Agent) :一种能够以多模态方式理解手机屏幕内容,通过自主推理与规划,在图形用户界面(Graphical User Interface,GUI)上执行类人操作(点击、滑动、输入)来帮助用户完成任务的智能系统-11。

3.2 拆解关键词

多模态:同时处理图像(屏幕截图)、文本、语音等多种输入

自主推理:不依赖预设脚本,动态分析当前界面并决策下一步动作

GUI操作:模拟真实用户的手指操作,而非调用App接口

3.3 生活化类比

把手机屏幕AI智能体想象成一个“能看懂屏幕的虚拟实习生”——你告诉它“去美团给我点一杯咖啡”,它会像人一样:打开App → “咖啡” → 选择店铺 → 加入购物车 → 确认下单。整个过程它“看着”屏幕操作,而不是通过后台接口-11。

3.4 核心价值

解决三大核心痛点:低延迟(数据不离开设备)、隐私保护(本地处理)、跨App自动化(打破应用孤岛)-51。

四、关联概念讲解:端侧大模型(On-Device LLM)

4.1 标准定义

端侧大模型(On-Device Large Language Model) :指在智能手机、平板等终端设备上直接运行的大语言模型,无需将数据上传至云端服务器。

4.2 与Agent的关系

Agent是“大脑”的工作方式:负责规划任务、做出决策

端侧大模型是“大脑”本身:提供理解、推理、生成的能力

一句话记忆:Agent = 执行者,端侧大模型 = 能力底座。

4.3 2026年端侧大模型的最新突破

2026年4月,谷歌正式发布Gemma 4系列,其中E2B(激活约20亿参数)和E4B(激活约40亿参数)两个端侧模型针对移动设备优化,可在手机、树莓派等设备上离线运行,延迟接近零-2。此前,苹果推出Ferret-UI Lite,仅30亿参数即可看懂复杂屏幕内容,性能匹敌大24倍的模型-3。

4.4 运行机制

否

是

用户自然语言指令

端侧大模型解析意图

感知当前屏幕UI

规划操作步骤

执行点击/滑动/输入

任务完成?

返回结果

五、概念关系与区别总结

| 维度 | AI智能体(Agent) | 端侧大模型(On-Device LLM) |

|---|---|---|

| 角色定位 | 执行者 / 规划者 | 能力底座 / 推理引擎 |

| 核心职责 | 感知屏幕、规划动作、执行操作 | 理解语言、生成内容、逻辑推理 |

| 输入输出 | 屏幕图像 → 操作指令 | 文本/图像 → 文本/答案 |

| 运行位置 | 端侧 + 可选云端 | 端侧(本地部署) |

核心结论:端侧大模型提供了“能理解”的能力,Agent赋予了“能操作”的能力,二者结合才构成完整的手机屏幕AI助手。

六、代码示例:Phone Agent 框架实现

Phone Agent 是一个基于AutoGLM构建的手机端智能助理框架,以下展示其核心调用逻辑-11:

Phone Agent 框架示例 from phone_agent import PhoneAgent 初始化Agent(自动连接手机ADB) agent = PhoneAgent(device_id="emulator-5554") 自然语言指令执行 agent.run("打开小红书,'手机AI助手教程',点赞第一条笔记") 内置安全机制 agent.on_sensitive_action = lambda action: input(f"确认执行 {action}?(y/n)")

关键代码解释:

ADB通信:通过Android Debug Bridge与手机建立连接,实现屏幕截图和触控模拟

视觉语言模型:分析屏幕截图,识别按钮、图标、文本框等UI元素

规划器:根据当前界面状态和目标任务,生成下一步操作序列

Google于2025年5月在ML Kit中推出了端侧GenAI API,开发者可以几行代码集成Gemini Nano:

ML Kit 端侧AI API示例 from google.mlkit import GenerativeModel model = GenerativeModel("gemini-nano") response = model.generate_content("总结这段文本") 完全本地运行,无需网络连接

该API支持摘要、校对、重写和图像描述等任务,在Pixel 9 Pro上处理文本速度达510 tokens/s-36。

七、底层原理与技术支撑

7.1 硬件层:NPU的崛起

手机端AI能力的根基在于NPU(Neural Processing Unit,神经网络处理器) 。2025年旗舰芯片AI算力爆发:

高通Snapdragon 8 Elite Gen 5:Hexagon NPU效能提升37%,NPU推理比CPU快100倍-21-23

联发科天玑9500:内置NPU 990与Gen AI Engine 2.0,支持128K长文本-22

预计2025年高阶移动平台峰值AI效能将突破100 TOPS,约为2021年的近4倍-25。

7.2 软件层:推理框架与模型压缩

推理框架:TensorFlow Lite、ONNX Runtime、MNN等框架将模型转换为手机可运行的格式。例如MNN-LLM在Android CPU推理中,prefill速度是llama.cpp的8.6倍-5-。

模型压缩:通过量化(Quantization) 将浮点数权重转换为INT4/INT8,使3B参数模型压缩至几百MB-51。Liquid AI的LFM2.5-1.2B-Thinking仅需900MB内存即可在手机上流畅运行-8。

7.3 端云协同:混合推理架构

当本地算力不足时,采用混合推理(Hybrid Inference) ——优先在端侧运行,复杂任务回退到云端:

Firebase AI Logic 混合推理配置 from firebase_ai import getGenerativeModel 优先使用端侧模型 model = getGenerativeModel(ai, {mode: "prefer_on_device"}) result = await model.generateContent("帮我写一封邮件") SDK自动处理端侧→云端的回退逻辑

八、高频面试题与参考答案

面试题1:手机端AI与云端AI的核心区别是什么?

答案要点:

运行位置:端侧AI在设备本地运行,云端AI依赖远程服务器

延迟:端侧<200ms,云端取决于网络(通常>500ms)

隐私:端侧数据不出设备;云端需上传

成本:端侧无API调用费;云端按token计费

算力上限:端侧受NPU/内存限制(如5-15 TOPS);云端算力近乎无限-51

面试题2:如何将大模型部署到手机端?

答案要点:

模型压缩:量化(INT4/INT8)+ 知识蒸馏,将体积从GB级降至MB级

格式转换:通过ONNX/TFLite转换器转为手机兼容格式

推理框架集成:选用TensorFlow Lite或MNN,利用NPU/GPU加速

内存优化:动态加载+KV缓存压缩,避免OOM-57

面试题3:什么是手机端AI智能体?与传统语音助手有何区别?

答案要点:

传统助手:语音/文字问答为主,无法操作手机

AI智能体:多模态理解屏幕 + 自主规划 + GUI操作(点击/滑动/输入)

典型代表:豆包手机助手、AutoGLM,可实现跨App复杂任务-12

面试题4:模型量化如何实现?精度损失如何控制?

答案要点:

原理:将32位浮点数映射到低比特整数(如INT8)

方法:训练后量化(PTQ)或量化感知训练(QAT)

精度控制:分组量化 + 校准集优化,损失通常<2-3%-57

面试题5:NPU相比CPU/GPU在AI推理中的优势?

答案要点:

专用架构:针对矩阵乘法和卷积运算硬件优化

能效比:相同任务功耗仅为CPU的1/10~1/100

延迟:高通NPU推理比CPU快100倍,50+模型<5ms-23

九、结尾总结

核心知识点回顾:

✅ 手机屏幕AI助手 = 端侧大模型(理解能力)+ AI智能体(操作能力)

✅ 端侧大模型通过量化压缩至几百MB,配合NPU实现低延迟推理

✅ 智能体通过ADB控制手机,以视觉语言模型感知屏幕并规划操作

✅ 推理框架(TFLite/ONNX/MNN)负责模型在手机端的实际运行

✅ 端云协同兼顾低延迟与复杂任务的准确性

易错点提醒:

不要混淆“Agent”和“大模型”——前者是规划执行者,后者是能力底座

不要误以为端侧AI需要网络——端侧模型可完全离线运行

进阶预告:下一篇将深入端侧模型部署实战——如何将DeepSeek-R1量化后部署到Android手机,带你从零完成一个离线AI助手的搭建。敬请期待!

本文数据来源:截至2026年4月10日的公开技术报告与官方公告,包括谷歌Gemma 4发布会、苹果Ferret-UI Lite论文、高通/联发科芯片规格、行业测试数据等。